���ɶԿ����磺google GAN�㷨������ƭ�˵ģ�GANԭ����ʲô

2018-12-24 16:12

�����ɶԿ���·��GAN������һ����ѧ�ᡸƭ�ˡ��ģ�

���㷨�����������־�ѧ�еġ��ڹ������ǵ�����������Ҫ�Ļ�ʯ�����������㷨����Ҳ���鷳�������Ƴ³��µ����㷨�Ƿ���¸�����ã���ִһ�ʣ����۰��һ��û�С��ڹ����������ܳ�Ϊ���֣����ڹ������ˣ���������ħ��

���������һ�����㷨���ں�ʱ�Ժ��ַ�ʽ������ò�����ģ��ܸ������������������ں�δ������������㷨��ʷ���ʹ���������AIȦ�����ŵĻ���ѧϰģ��GAN˵��

�Ӵ�ͳģ�͵������GAN2.0���������㷨��������Щ�仯��

���ɶԿ���·��GAN, Generative Adversarial Networks ����һ�����ѧϰģ�ͣ���Ϊ���ලѧϰ�����ǰ�������㷨֮һ����������2014����ѧ��Ian J. Goodfellow��������ġ�

��GAN�����������ѧϰ֮ǰ���Ѿ��кܶ�����ģ�͡�������ģ���Ǵӻ���ͳ�ƽǶȳ����ģ�ָ��������������ɿɹ۲����ݵ�ģ�ͣ�����ֱ�������ͽ�ģ�����о���Ա�����˲�����ս��

����˵��ͳ��ͼ������ģ�ͣ���ͼ���ʾΪһ���������������ÿһά�ȶ�����һ������ֵ��Ȼ�������Ȼ�����е�ͼ����һ��δ֪�ķֲ�����ͨ��һЩ�۲�������������ֲ���

��Ȼ����������������ֱ�ӽ�ģ������ģ�ͣ��ÿ�����Ա�����˲������ѡ���Ϊ��Ҫ��һ���ǣ�ϵͳ���ж�Ԥ������Ʒ�ʺû���

�����ɶԿ���·��GAN������һ����ѧ�ᡸƭ�ˡ��ģ�

��ԭʼ��GAN�����dz�֮ΪGAN1.0�����������ѧϰ���˳���Ӧ�˶�����

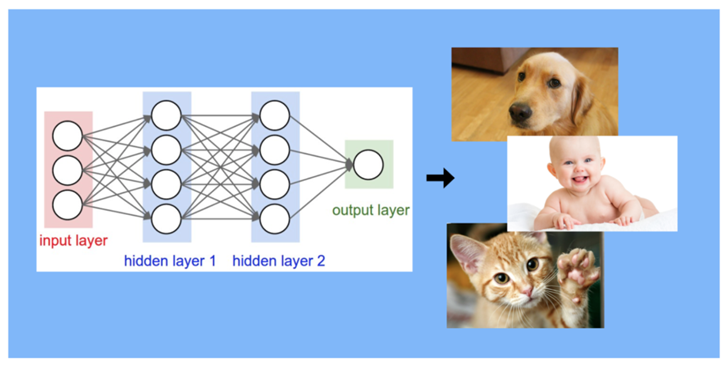

GAN1.0�������������������·ģ�����⺭�����������ø��ӵķֲ��жϵ��Ա���ģ�����������˼�������

���ǡ���������·���͡���������·������ģ�һ����ͣ�ز����ݲ�����������һ����ͣ������ɺ���ս���ж������ɵ������Ƿ���ʵ�������ҶԿ����ϸĽ������մﵽ�ܺõ���������

�����ɶԿ���·��GAN������һ����ѧ�ᡸƭ�ˡ��ģ�

����˵��GAN�������������㷨�ġ�ʵ��ʱ��������Ȼ����������ʮȫʮ���ģ����GAN1.0һЩ��δ��������⣬�������˲��ٱ������㷨��

����Alec Radford et. Al��GAN����һЩ�ܹ��ϵ���ѻ���ʹ�ó��������Ż����Ľ�֮���Եõ��������������ͼƬ��

�����ɶԿ���·��GAN������һ����ѧ�ᡸƭ�ˡ��ģ�

���˵GAN1.0�����������Ѿ���������Ͷ�أ���ô���NIVIDA�о���Ա�Ƴ���������GAN�����dz�֮ΪGAN2.0���������㹻�е����ȡ�

GAN2.0�����˻��ڷ����������½ṹ�����Խ�����ϸ�ڷ����������ģ�ͽ��е�������������������ͼ��������ȳ�Խ��GAN1.0������ģ�͡�

֮������˾��ˣ�һ����ΪGAN2.0���Ը��õظ�֪ͼ��֮��������ı仯������������������ò��������������棬���һ�����������������羰ͼ��IJ�����

�����ɶԿ���·��GAN������һ����ѧ�ᡸƭ�ˡ��ģ�

��ʷ�������������֮���ѿ��������ѧϰΪ��������ȵ��������㷨�춨�˻����Ϳ��ܡ���GAN�ĶԿ��Լ���Ӧ�ü�ֵ������ͼ���������㷨��Ϊ��һ��������֮���͵�������

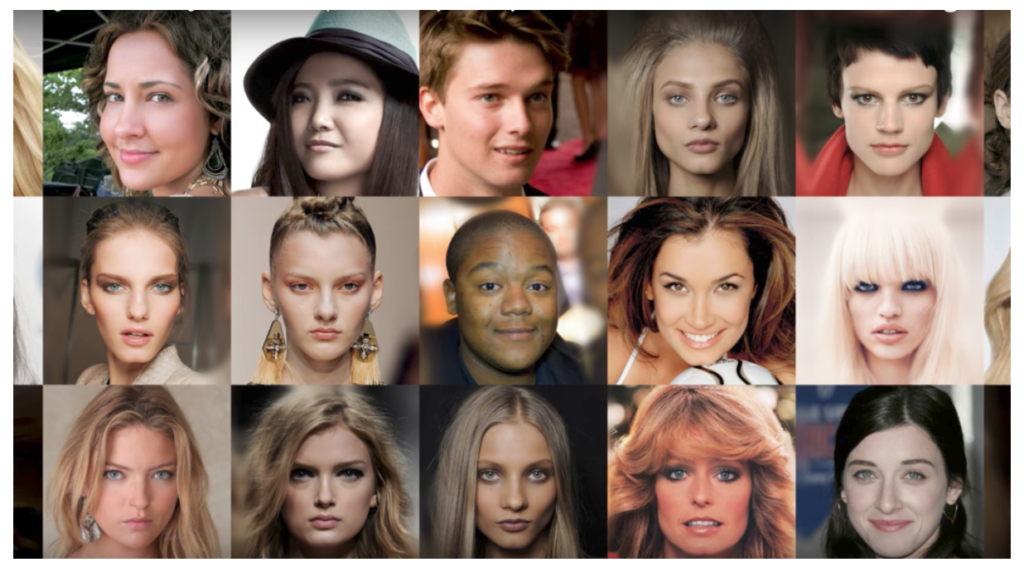

GAN��һС����ͼ�����ɵ�һ��

��ô��GANģ�ͷ�չ�����ڣ���������ʲô���ı仯���ִ����еػ������Щ�����أ�

��Ҫ���������¼������棺

1.���ص㡣 GAN2.0���õ��������ܹ�����ȡ��ͼ�������DZʻ�����ɫ�ռ����ֽ�Ӳ�����ݣ�����ͼ�����ɺ��������������ȷ����ԣ���˿��Ը�֪��ͼ��֮����Щ�仯��������ģ��������״������Щ���������ص��ע����������ɫ������˱����Ŀ��Ƹ�ϸ�壬���ɵ�Ч����ȻҲ��Խ���档

2.�ų�����ͼ���кܶ�����Ҳ�����ҪӰ���ϸ�ڣ�����ë����ȸ�ߵľ���λ�õȵȣ�ֻҪ���ϻ����Ĺ���ֲ���GAN2.0����������һЩ����仯����

3.ʡ��Դ�� GAN2.0���Խ�����������ͼ��������ţ�����ζ�ţ���û����ȷָ��������ѧϰ�����£�ϵͳ�ܹ������ж�ʹ��ȫ�ֱ����عܵ�������������������Ч�ʡ�

�����ɶԿ���·��GAN������һ����ѧ�ᡸƭ�ˡ��ģ�

�� GAN���Ըı�ͼ���еļ���

�ⱳ�������ŵģ��������㷨�ı�Դ��ֵ——�Ǿ��ǽ��Ͻ��Ŀ�ѧ��֤˼ά������ʵ�Ĺ��̷������ϣ���������һ����ѷ�����

�����嵽����������ʱ�����㷨�ġ���Խ�ԡ��������������㣺һ���ܹ���ȷ���жϺ�Ԥ��̼���λ�ã����ǿ��Խ��и�С���ȵص������ý������Ȼ������Ǹ����������ʹ������������㷨���ӵĿռ����

��Ȼ��GAN�ķ�չ����������ӽ��������������ٵ�����ʱ��Ӧ����ѭ�Ļ�������

GAN����ӳ������㷨������

GAN��һ���㷨�Ľ����������˺ܶ����ʵ���������

����������Ϥ�ķ�������������ָ���������ȳ���Ӧ��֮�⣬����һЩ��ģ���������Ӵ�����ռ���ſ�Ӧ�á�

���磬�ȸ������GAN������·ѧ�����롣ϵͳ��������ȫ����ص�ͼ���У�����һЩ�빷�����ӡ�������������֮����Ȼ��ƾ���Լ��ġ���������������ֳ�������Щ��õĻ���������һ�ֻ��������ġ��ȷ����������������źܶ�����˼άҲ��������������ڱ�����·����

���⣬��GAN�������£�������ģ�����ද�����ǻ������ڳ�Ϊ���ܡ����������㷨������Ҫ������ģ�����ݼ��ʹ���ѵ�����ܹ��бȽ�����ı��֡�����ģ��ѧϰ�У��ǻ������轱�����ƾͿ�����������ѧϰ��

�����ŵ� �ǣ������������轱������������ƾ�衸�����ġ���һ�ź�ȥ����̽������ʹ�û�����ѧϰ�ɱ���̽����Χ��ѧϰЧ�ʶ�Ҫ��������ʽҪǿ�öࡣ

�ܶ���֮��GAN�Ľ��������������ظ��ܵ��˻���ѧϰ��ģʽ�ͳɱ����ڷ����߸�ʽ�ĸı䡣

�ⱳ���������������㷨�����ĺ����ص㣺

1.����ѧϰ�����ල�����мල����DZ������GAN1.0�������Ļ𱬣���GAN2.0������ͻ�ƣ����Կ������ܹ��������κμල��Ϣ��������������ѵ���������ܹ����ҽ��������㷨������ͨ���˹��ǻ۵Ļ�ʯ��

2.Ч�����ϣ�����Ч��̸�������ǿ�̸��ʵ����������㷨δ���ܹ�������ҵӦ�õij�����Ҫ����ʵ���У�����Ҫ�����ɱ������ĥ�ϼ��Դ����̣�������Ч�����⡣ GAN�Ľ������̣�����һ���ӵ���ȫջ��Դ�������ú���������ƿռ䣬���á������ӡ������㷨��������ͨ�����ܻ�����ʵ���硣

GAN3.0δ�����ܵ�����

������е�����������ǿ�������һ�£����δ����������GAN3.0��������ʲô���ӣ�

���ﲻ�����Զ�һ�£�

���ȣ�GAN3.0һ������2.0�����ϸ���ά�ȵ������������ϻ��������������ļӳ֣�Ч�������پ����ڸ߾���ģ������������ģ����ʵ���磬���������Υ�е�ȫ�����֣���Ϊ�¡������������Ǽ��п��ܵġ�

���⣬GAN3.0��������ģ�;��ȵ�Ҫ����ͣ����ʹ������Ԥ���Ϊ���ܣ���Ҳ��ζ������NIVIDA��Google�Ȳ��Ͽ����Լ������ݼ����ܶ�С��˾Ҳ�п������յ������Ż�ϵͳ��������Ҳ����GAN3.0������ߣ����ڻ��ڳ�����ĬĬд��ʽ���ء�

��һ������Ҳ�����˾����ؼ���ı仯��δ���о��ߺ�ʹ����PK���ص㣬�����ڴ������ϡ����Ӧ�ø�ǿ��ĶԿ�������·��������ӵĻ����ǻ����⣬����IJ��������㷨������ǿ��������һ��˼ά�ͷ����ۡ�

����AI�����߸п���ÿ�ζ��о��õ��DZ��˼ҵ�GAN����������ͬ�ij�ʽ������ݼ����Լ�Ҳ����û����������ͬ��Ч������ͱ���֮���Dz���ֻ��һ�����㷨���Լ������ѵ���֪����

��;ͬ�飬�������GAN3.0����Ҳ��ع顸���㷨���ı��ʣ��Ǿ��������������λ�������˼ά�����ֶΡ�

Ҳ��ˣ�������ijһ���Ƚ������㷨��������ζ�ž�����������ھ��Ĺ��ᣬ���������������ģ��Dz��Ͼ����ġ��ڹ�����

�������

王健林许家印游艇曝光 网友:这次真是贫穷限制了我们的想像力

王健林许家印游艇曝光 网友:这次真是贫穷限制了我们的想像力2018-04-16 16:32

三季度全球可穿戴设备出货量上涨94.6%,苹果稳…

三季度全球可穿戴设备出货量上涨94.6%,苹果稳…2019-12-10 17:52

Samsung新专利曝光全面屏没有刘海

Samsung新专利曝光全面屏没有刘海2018-05-13 13:33

全幅高速连拍Canon1DX单机售28800元

全幅高速连拍Canon1DX单机售28800元2018-04-09 17:32

华为Mate X预计供货20万台左右

华为Mate X预计供货20万台左右2019-06-30 15:50

轻量级入门机:FujifilmX-M1无反登场

轻量级入门机:FujifilmX-M1无反登场2018-01-03 12:00

闪光灯竟有这么多花样魅蓝E2评测

闪光灯竟有这么多花样魅蓝E2评测2018-05-29 19:33

中科循环经济研究院在沧州成立

中科循环经济研究院在沧州成立2020-12-28 16:52

2018春节第一新机 魅蓝E3背面设计捉眼

2018春节第一新机 魅蓝E3背面设计捉眼2019-02-19 05:37

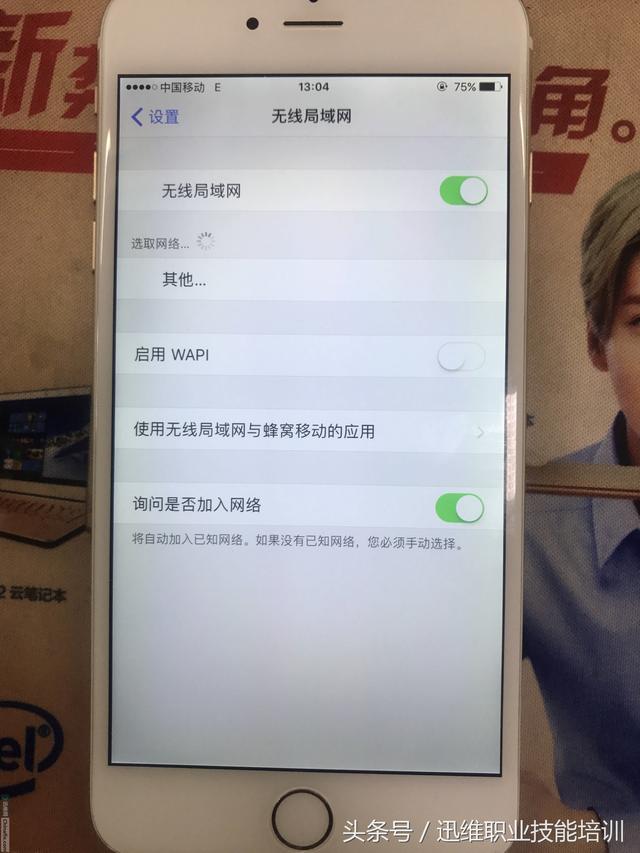

iPhone6Plus搜不到WiFi 手机店没修好 大神思路清晰一招搞定

iPhone6Plus搜不到WiFi 手机店没修好 大神思路清晰一招搞定2018-05-02 14:31

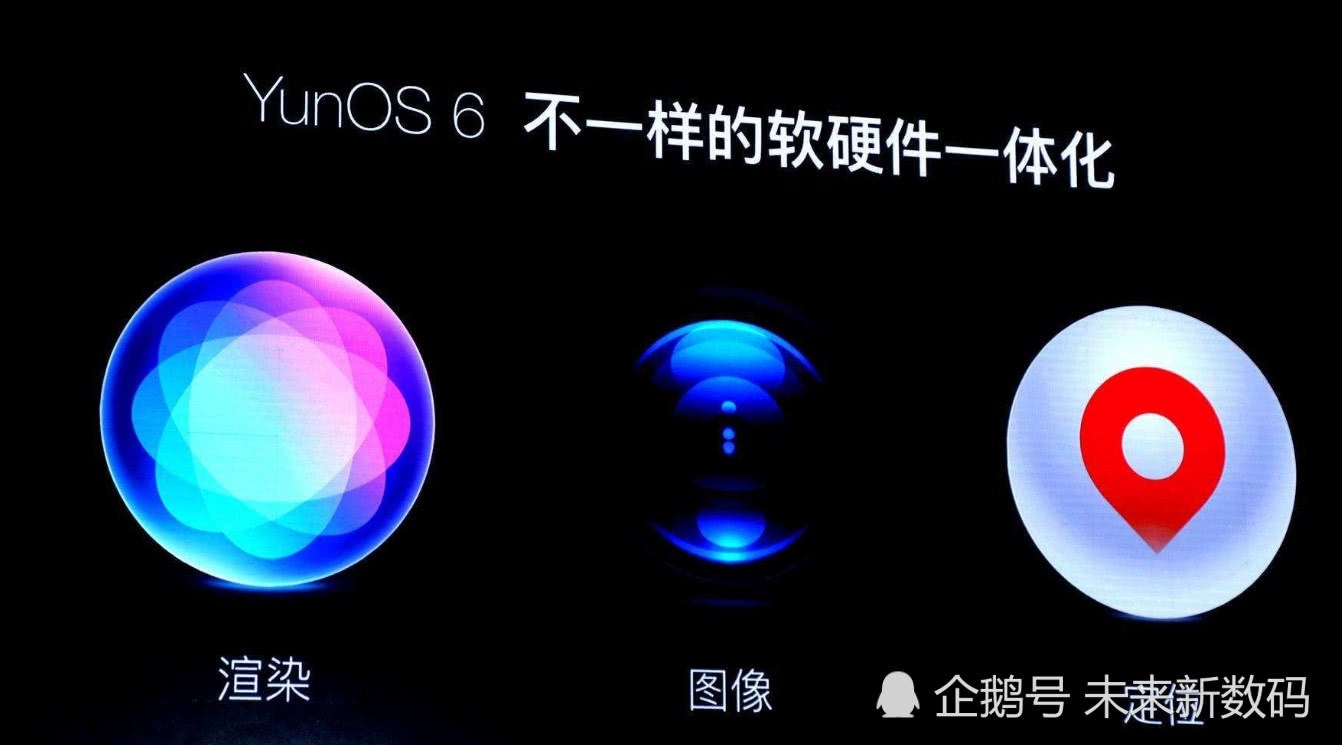

阿里YunOS即将到来 目前已有国产手机支持 期待吗?

阿里YunOS即将到来 目前已有国产手机支持 期待吗?2018-04-29 20:31

霸屏了!问卷网八周年感恩回馈活动火热进行中!

霸屏了!问卷网八周年感恩回馈活动火热进行中!2021-07-22 19:46

360摄像机3C云台电池版开启预售 创新“不插电…

360摄像机3C云台电池版开启预售 创新“不插电…2021-03-20 09:54

外媒报道:LG正研发新款翻盖式可折叠手机

外媒报道:LG正研发新款翻盖式可折叠手机2018-07-06 05:31

- 扎克伯格夫妇约会给孩子言传身教 扎克伯格家首次曝光

2019-12-05 18:53

5799元起 三星GalaxyS9/S9+勃艮第红版发布 三大女神代言

5799元起 三星GalaxyS9/S9+勃艮第红版发布 三大女神代言2018-05-08 17:32

印度造iPhone终于上市 但果粉依旧很失望

印度造iPhone终于上市 但果粉依旧很失望2018-09-22 00:32

更生行薪酬ETC:智能薪酬市场的领跑者

更生行薪酬ETC:智能薪酬市场的领跑者2019-08-20 11:55

魔兽争霸:守城关卡的设定十分经典 那么战役中最经典的是哪关?_希尔瓦娜斯

魔兽争霸:守城关卡的设定十分经典 那么战役中最经典的是哪关?_希尔瓦娜斯2019-06-30 14:46

脑洞飘出天际的科研队伍开发出3D打印水质检测器

脑洞飘出天际的科研队伍开发出3D打印水质检测器2018-08-05 18:31